在产生式AI领域,推出ChatGPT的OpenAI处于领先地位。他们的GPT-4已经是万亿参数级别,他们还在训练更高级的GPT-5。届时,他们将在技术层面摆脱国内追逐者。

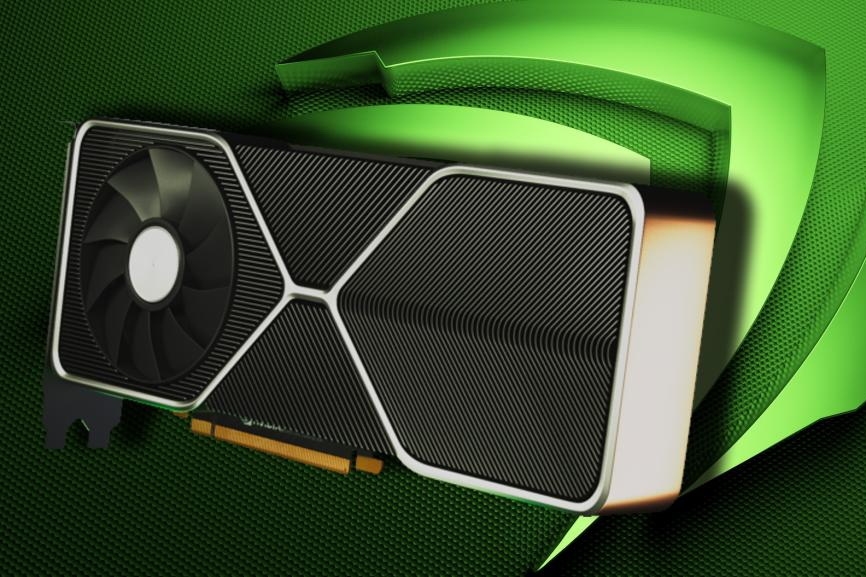

OpenAI可以带头,先进的AI显卡使用GPU是不可或缺的,背靠微软的树,他们将不受计算资源的限制,GPT-4培训使用2万NVIDIAAI显卡培训。

然而,10000块显卡的计算能力并不是终点。同样在今年加入AI的搜狗前CEO王小川日前在接受采访时透露了开放AI的趋势。[email protected]

1000万GPU的概念是什么?目前NVIDIA年产量为100万个GPU(AI中应主要指GPU),OpenAI的规模相当于10倍于NVIDIA年产能的水平。

王小川表示,OpenAI的千万GPU微积分的目标是登月计划,他显然认为这很棒。

不管这些GPU显卡能否生产、购买成本有多高,单是1000万块显卡互联的难度是不可想象的。如果做到了,OpenAI就会所向披靡。

然而,这也让人怀疑,是OpenAI的表述错了,还是王小川听到的投行报告是错的,从数万个GPU到千万个GPU互联互通的难度并不是一个级别。